Page 14 - KAIST GSIS 2023 Vol.09

P. 14

04 DarkBERT:

A Language Model for the Dark Side

of the Internet

KAIST 전기및전자공학부 진영진 박사 과정, KAIST 정보보호대학원 신승원 교수, 및 S2W 연구진으로 구성된 연구팀은 다크 웹 언어 데이터로 학습된

새로운 언어모델인 DarkBERT을 개발하였다. DarkBERT는 사이버 보안 분야 및 범죄 수사 등에 다양하게 활용될 수 있으며, 그 우수성을 인정받아 세

계 최고 권위 자연어처리 (NLP) 학술대회인 Annual Meeting of the Association for Computational Linguistics (ACL) 2023에 채택되었다.

다크 웹은 일반적인 검색 엔진으로 검색하거나 접근할 수 없는 인터넷 영역으로, 사용자의 익명성을 보호하며 특정 웹 브라우저를 사용해야만 접근

할 수 있다. 일반적으로 Tor(The Onion Router)와 같은 특수 브라우저를 사용하여 암호화된 네트워크를 통해 접속하게 되어있다. 익명으로 데이터를

공유할 수 있는 특성상, 마약 거래, 무기 판매, 해킹 서비스 제공 등을 포함한 사이버 범죄 활동에도 악용될 수가 있다. 최근 다크 웹에서 사용되는 언어

와 서피스 웹(일반 웹 사이트들)의 언어 사이에 단어적 및 구조적 차이가 어느 정도 존재함을 제시하는 연구 결과가 있었다. 다크 웹에 대한 연구는 주

로 텍스트 분석이 필요하므로, 다크 웹에 특화된 언어 모델은 앞으로 다크 웹 관련 연구를 더욱 효과적으로 진행할 수 있을 것으로 전망된다. 본 연구에

서는 다크 웹 데이터를 사전 훈련한 (pretrained) 언어 모델인 DarkBERT를 선보였다. 다크 웹의 극단적인 어휘적 및 구조적 다양성 및 사이버 보안에

관련 없는 콘텐츠를 고려하여 DarkBERT를 훈련하기 전 데이터 클리닝 작업이 따로 추가되었다. 또한, RoBERTa라는 기존 모델 아키텍처를 베이스로

두어, 다량의 다크 웹 데이터를 이용해 1달간 학습을 진행하였다.

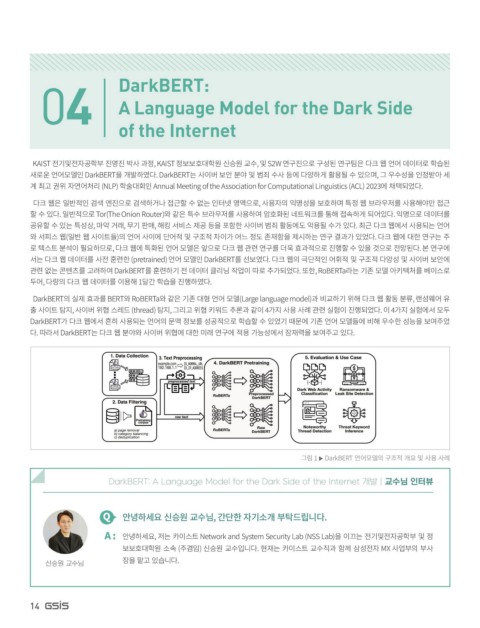

DarkBERT의 실제 효과를 BERT와 RoBERTa와 같은 기존 대형 언어 모델(Large language model)과 비교하기 위해 다크 웹 활동 분류, 랜섬웨어 유

출 사이트 탐지, 사이버 위협 스레드 (thread) 탐지, 그리고 위협 키워드 추론과 같이 4가지 사용 사례 관련 실험이 진행되었다. 이 4가지 실험에서 모두

DarkBERT가 다크 웹에서 흔히 사용되는 언어의 문맥 정보를 성공적으로 학습할 수 있었기 때문에 기존 언어 모델들에 비해 우수한 성능을 보여주었

다. 따라서 DarkBERT는 다크 웹 분야와 사이버 위협에 대한 미래 연구에 적용 가능성에서 잠재력을 보여주고 있다.

그림 1 ▶ DarkBERT 언어모델의 구조적 개요 및 사용 사례

DarkBERT: A Language Model for the Dark Side of the Internet 개발 | 교수님 인터뷰

Q 안녕하세요 신승원 교수님, 간단한 자기소개 부탁드립니다.

A : 안녕하세요, 저는 카이스트 Network and System Security Lab (NSS Lab)을 이끄는 전기및전자공학부 및 정

보보호대학원 소속 (주겸임) 신승원 교수입니다. 현재는 카이스트 교수직과 함께 삼성전자 MX 사업부의 부사

신승원 교수님 장을 맡고 있습니다.

14 Graduate School Of Information Security 15